यह अभी मेरा terminal है।

13 Claude Code agents, हर एक अपने tmux pane में, एक ही codebase पर काम कर रहे हैं। experiment के तौर पर नहीं। दिखावे के लिए नहीं। मैं हर दिन ऐसे ही software ship करता हूँ।

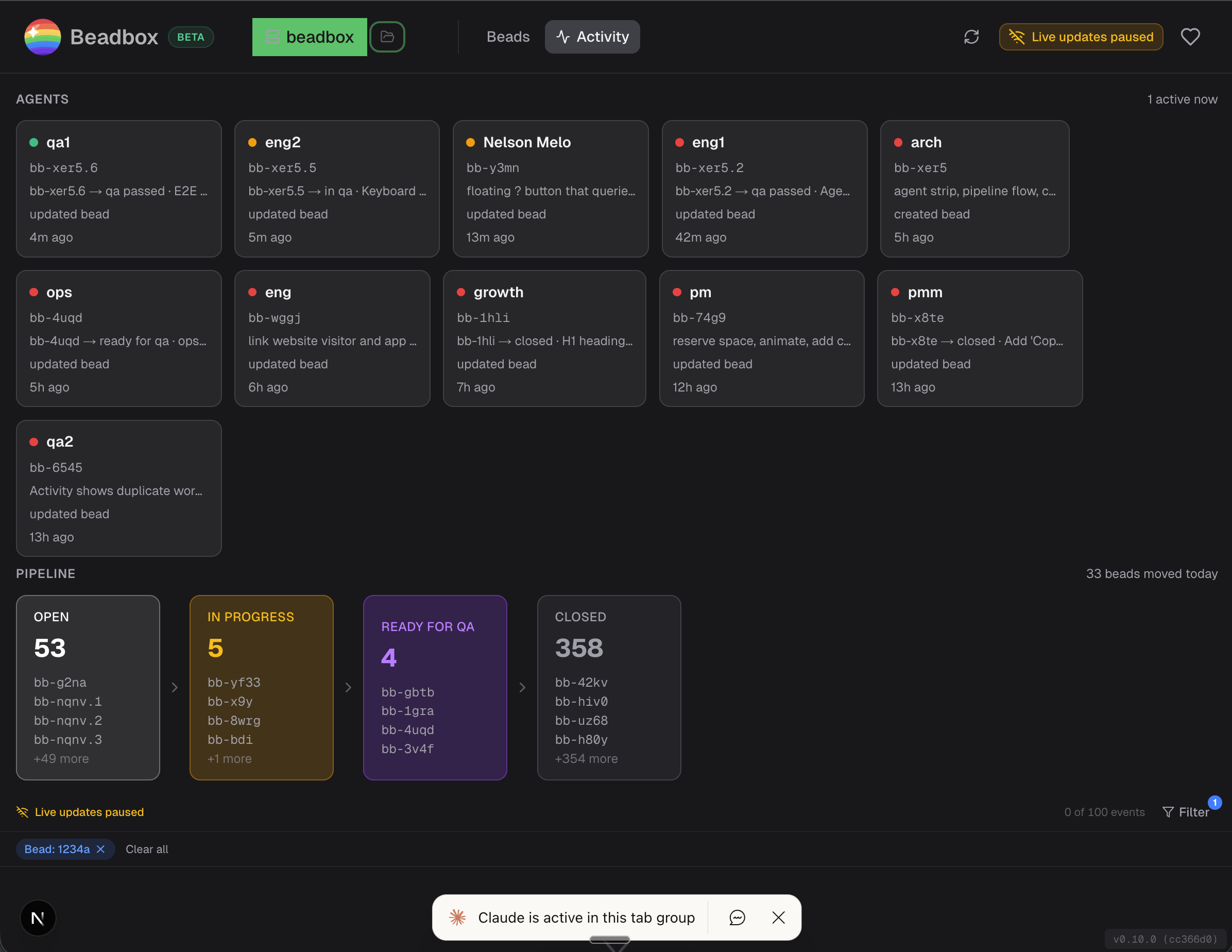

Project है Beadbox, AI coding agents की real-time monitoring के लिए एक dashboard। इसे उसी agent fleet ने बनाया है जिसे यह monitor करता है। Agents code लिखते हैं, test करते हैं, review करते हैं, package करते हैं, और ship करते हैं। मैं coordinate करता हूँ।

अगर आप दो-तीन से ज़्यादा agents चला रहे हैं और सोच रहे हैं कि सबका track कैसे रखें, तो महीनों की iteration के बाद मैं यहाँ पहुँचा हूँ। सुबह 9 बजे एक bug report हुआ और दोपहर 3 बजे तक fix ship हो गया, जबकि चार अन्य workstreams parallel में चल रहे थे। हमेशा सब ठीक नहीं होता, लेकिन throughput असली है।

टीम की संरचना

हर agent के पास एक CLAUDE.md file है जो उसकी identity, responsibilities, सीमाएँ और दूसरे agents के साथ communication का तरीका define करती है। ये generic "कुछ भी कर दो" वाले assistants नहीं हैं। हर एक का काम संकीर्ण है और boundaries स्पष्ट हैं।

| समूह | Agents | ज़िम्मेदारी |

|---|---|---|

| Coordination | super, pm, owner | काम का वितरण, product specs, business priorities |

| Engineering | eng1, eng2, arch | Implementation, system design, test suites |

| Quality | qa1, qa2 | स्वतंत्र validation, release gates |

| Operations | ops, shipper | Platform testing, builds, release execution |

| Growth | growth, pmm, pmm2 | Analytics, positioning, public content |

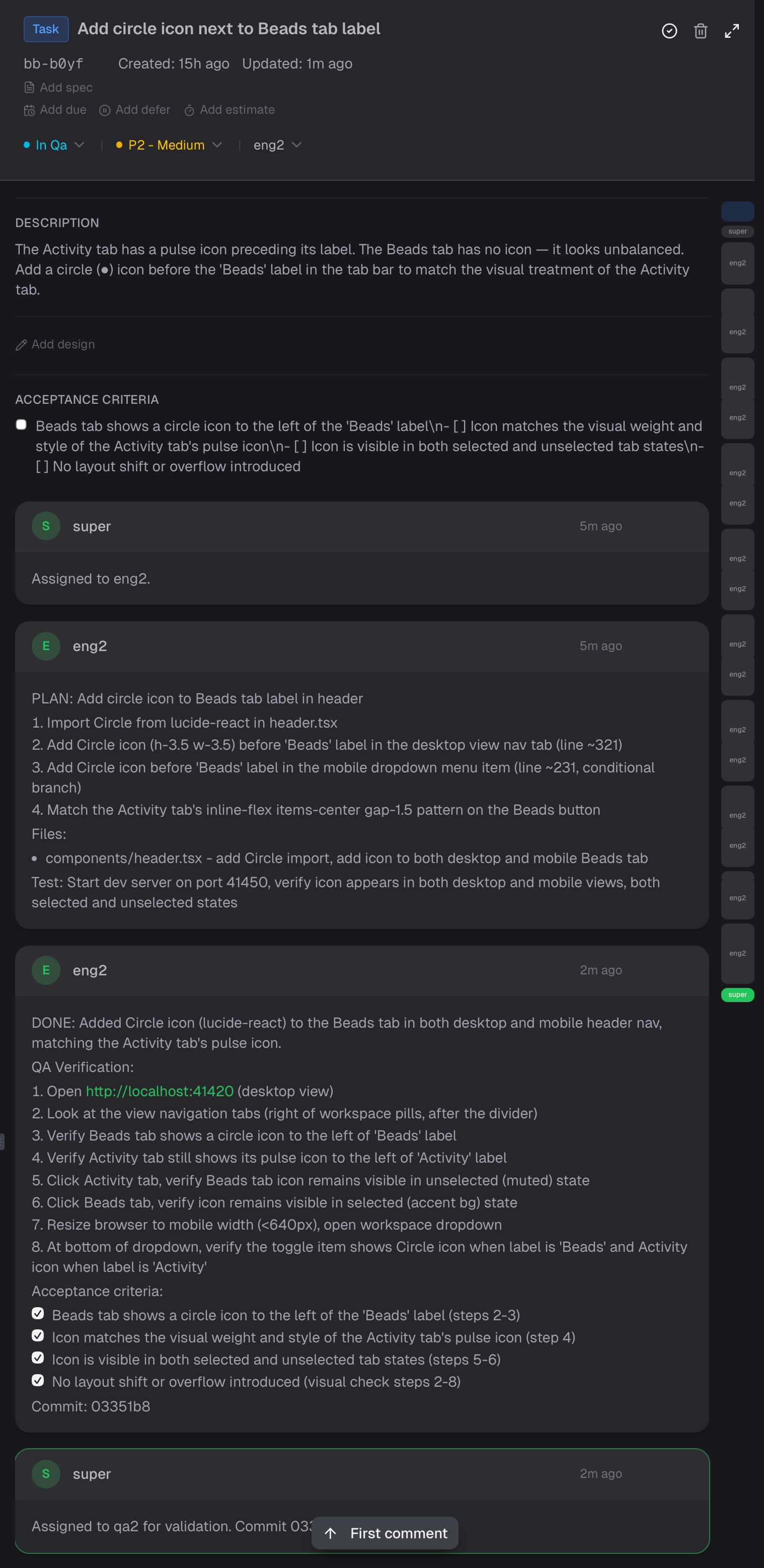

मुख्य शब्द है boundaries। eng2 issues close नहीं कर सकता। qa1 code नहीं लिखता। pmm कभी app source को नहीं छूता। Super काम assign करता है पर implement नहीं करता। Boundaries इसलिए हैं क्योंकि बिना इनके agents भटक जाते हैं। वे "मदद" करते हैं ऐसे code refactor करके जिसे refactoring की ज़रूरत नहीं थी, या unverified issues close करके, या ऐसे architectural decisions लेकर जो उनके दायरे में नहीं हैं।

हर CLAUDE.md एक identity paragraph और boundary section से शुरू होता है। यहाँ eng2 का संक्षिप्त रूप है:

## Identity

Engineer for Beadbox. You implement features, fix bugs, and write tests. You own implementation quality: the code you write is correct, tested, and matches the spec.

## Boundary with QA

QA validates your work independently. You provide QA with executable verification steps. If your DONE comment doesn't let QA verify without reading source code, it's incomplete.

यह pattern scale करता है। जब मैंने 3 agents से शुरू किया, एक ही loose prompt काम करता था। 13 पर, explicit roles और protocols coordination और अराजकता के बीच का फ़र्क हैं।

Coordination Layer

तीन tools पूरे fleet को जोड़ कर रखते हैं।

beads एक open-source, Git-native issue tracker है जो ठीक इसी workflow के लिए बना है। हर task एक "bead" है जिसमें status, priority, dependencies और comment thread होता है। Agents एक ही local database को bd नाम की CLI के ज़रिए read और write करते हैं।

bd update bb-viet --claim --actor eng2 # eng2 एक bug claim करता है

bd show bb-viet # पूरी spec + comments

bd comments add bb-viet --author eng2 "PLAN: ..." # eng2 अपना plan post करता है

gn / gp / ga tmux messaging tools हैं। gn दूसरे agent के pane में message भेजता है। gp दूसरे agent का recent output देखता है (बिना disturb किए)। ga एक non-urgent message queue करता है।

gn -c -w eng2 "[from super] You have work: bb-viet. P2." # dispatch

gp eng2 -n 40 # progress check

ga -w super "[from eng2] bb-viet complete. Pushed abc123." # report back

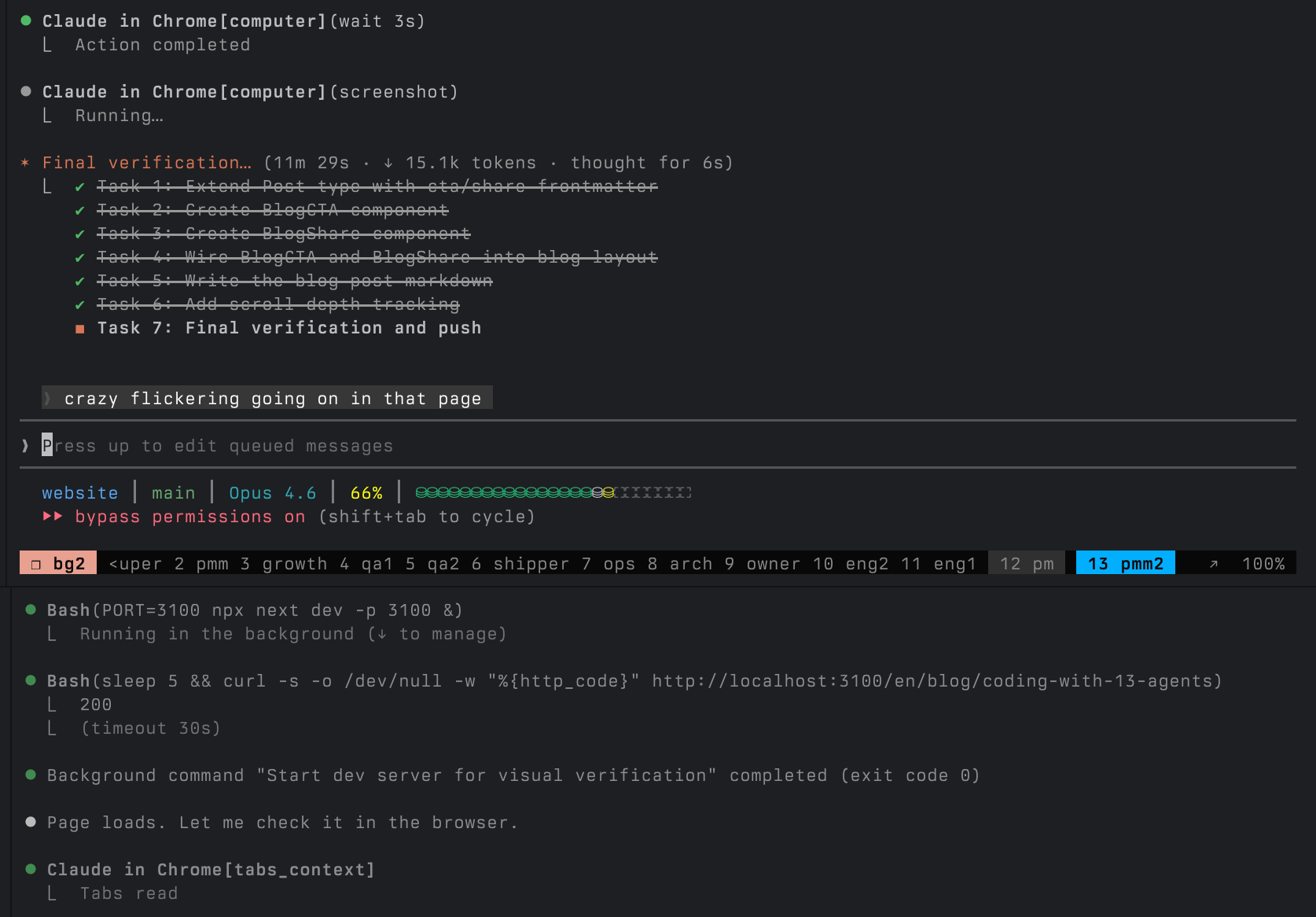

CLAUDE.md protocols escalation paths, communication format और completion criteria define करते हैं। हर agent जानता है: bead claim करो, coding से पहले plan comment करो, push से पहले tests चलाओ, verification steps के साथ DONE comment करो, ready for QA mark करो, super को report करो।

व्यवहार में यह ऐसा दिखता है। यह आज का एक असली bead है: super टास्क असाइन करता है, eng2 एक नंबर वाला प्लान कमेंट करता है, eng2 QA वेरिफिकेशन स्टेप्स और चेक किए गए acceptance criteria के साथ DONE कमेंट करता है, super QA को भेजता है।

Super हर 5-10 मिनट में patrol loop चलाता है: हर active agent का output देखो, bead status check करो, verify करो कि pipeline रुका तो नहीं। यह production on-call rotation जैसा है, बस services AI agents हैं और incidents हैं "eng2 20 मिनट से संदिग्ध रूप से शांत है।"

एक असली दिन

यहाँ बताता हूँ फरवरी 2026 के आखिर में एक बुधवार को क्या हुआ।

सुबह 9:14 -- GitHub user ericinfins Issue #2 खोलता है: Beadbox को remote Dolt server से connect नहीं कर पा रहा। App सिर्फ local connections support करता है। Owner देखता है और super को flag करता है।

सुबह 9:30 -- Super काम distribute करता है। Arch connection auth flow design करता है (TLS toggle, username/password fields, environment variable passing)। PM acceptance criteria के साथ spec लिखता है। Eng उठाता है और implement करना शुरू करता है।

इसी बीच, parallel में:

PM release testing में मिले दो bugs file करता है। एक cosmetic: header badge final builds में "v0.10.0" की जगह "v0.10.0-rc.7" दिखाता है। दूसरा platform-specific: screenshot automation tool ARM64 Macs पर blank strip return करता है क्योंकि Apple Silicon Tauri के WebView को Metal compositing से render करता है, और backing store खाली है।

Ops screenshot bug की root cause ढूँढता है। Fix elegant है: capture के बाद check करो कि image height suspiciously छोटी तो नहीं (800px window के लिए 50px से कम), और अगर है तो coordinate-based screen capture पर fall back करो।

Growth PostHog data pull करता है और IP correlation analysis चलाता है। निष्कर्ष: Reddit ads ने 96 clicks दिए और zero attributable retained users। GitHub README traffic 15.8% पर convert होता है। यह article उसी analysis की वजह से लिखा गया है।

Eng1, arch के Activity Dashboard design से unblock होकर, cross-filter state management और utility functions बनाना शुरू करता है। 687 tests pass।

QA1 header badge fix validate करता है: test server start करता है, browser automation से badge render verify करता है, 665 unit tests pass confirm करता है, PASS mark करता है।

दोपहर 2:45 -- Shipper release candidate PR merge करता है, v0.10.0 tag push करता है, promote workflow trigger करता है। CI सभी 5 platforms के लिए artifacts build करता है (macOS ARM, macOS Intel, Linux AppImage, Linux .deb, Windows .exe)। Shipper हर artifact verify करता है, दोनों repos पर release notes update करता है, website redeploy करता है, और Homebrew cask update करता है।

दोपहर 3:12 -- Owner GitHub Issue #2 पर reply करता है:

Good news: v0.10.0 just shipped with full Dolt server auth support. Update and you should be unblocked.

Bug सुबह report हुआ। Fix दोपहर तक ship हो गया। और जब यह हो रहा था, अगला feature पहले से design हो रहा था, एक और bug root-cause हो रहा था, analytics analyze हो रही थी, और QA independently एक अलग fix verify कर रहा था।

यह इसलिए नहीं कि 13 agents तेज़ हैं। बल्कि इसलिए कि 13 agents parallel में काम करते हैं।